"Retroalimentação"

IAs estão sendo treinadas com imagens de IA – e produzindo resultados bizarros.

À medida que aprendem com outras IAs, a qualidade das imagens geradas piora – os resultados ficam mais parecidos entre si.

As inteligências artificiais (IAs) que produzem imagens são treinadas com outras imagens. Existem bancos de dados gigantescos com figuras associadas a descrições. As IAs “aprendem” o que é cada coisa, e assim montam o que você pediu.

Se você quiser um desenho de um gatinho, a IA vai caçar as fotos de gatos e gerar um resultado similar. Funciona para várias coisas: uvas, pessoas, paisagens, objetos. Para entendermelhor como elas funcionam, leia esta matéria da Super.

Essas IAs funcionam “aprendendo” as associações entre imagens e palavras. De tanto ver imagens de um objeto cilíndrico, transparente, com tinta no centro, ponta colorida e uma tampa sendo descrito como uma caneta esferográfica, ele aprende que aquilo é uma caneta esferográfica.

Mas tem um problema: conforme as imagens de IA inundam a internet, elas se infiltram também nos bancos de dados de outras IAs. Essa “retroalimentação” faz com que os resultados produzidos pelos programas sejam piores em qualidade e em diversidade.

Isso foi posto à prova por um grupo de pesquisadores. Eles treinaram IAs em imagens geradas por elas mesmas ou com imagens reais. Seus resultados batem com as expectativas – IAs têm piores desempenhos.quando usam conteúdos de colegas para trabalhar.

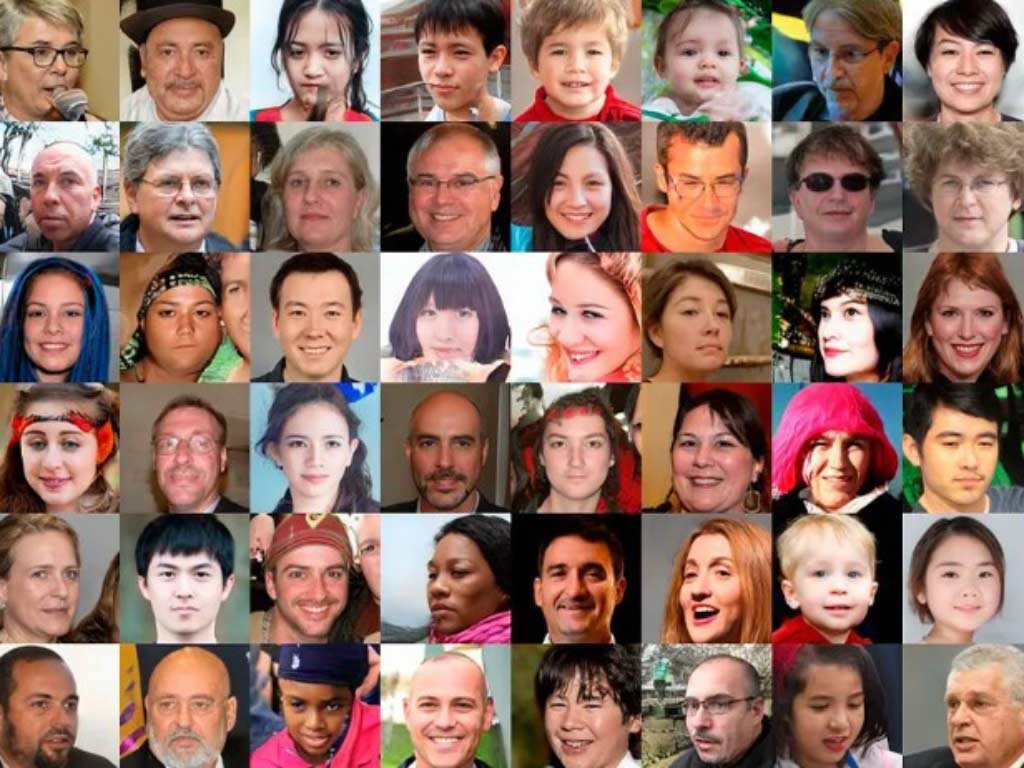

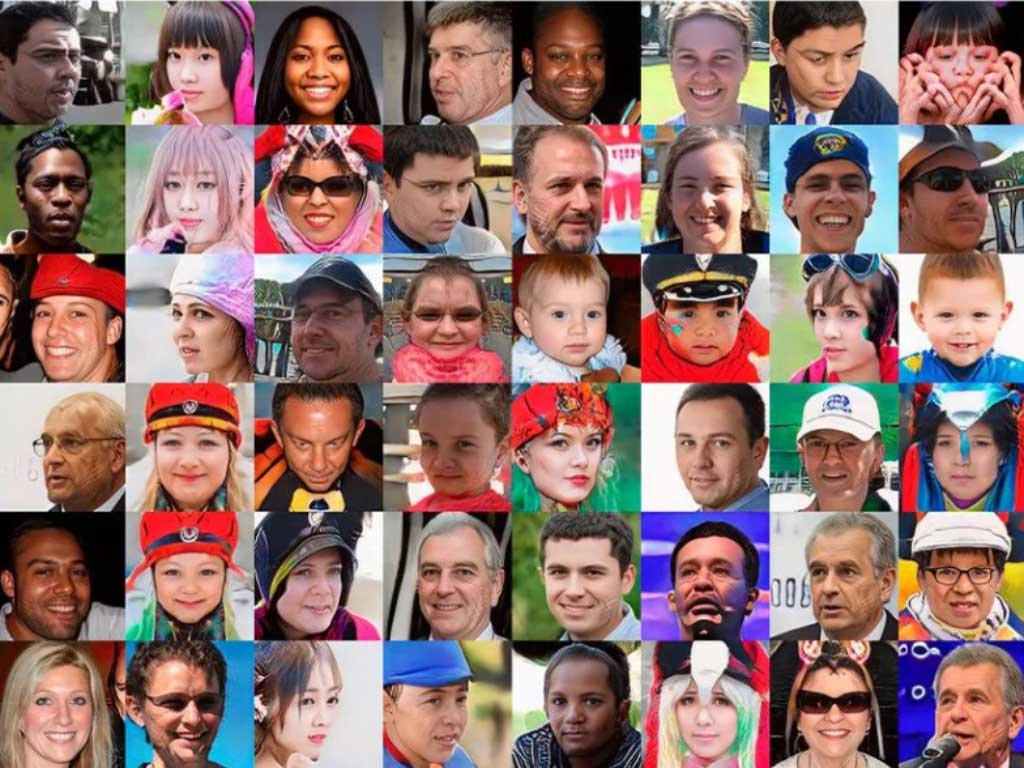

Usando um banco de 70 mil rostos humanos tirados do serviço de fotos online Flickr, os pesquisadores produziram uma primeira geração de imagens artificiais. A partir daí, a geração seguinte era treinada com as imagens da anterior, e assim por diante. Com o tempo, essa autofagia começou a produzir resultados borrados ou imagens com ruídos e falhas.

Os pesquisadores tentaram retardar essa piora, filtrando as imagens que treinariam a geração seguinte. Mas aí surgiu outro problema: selecionando as fotos com mais qualidade, eles diminuíram drasticamente a diversidade dos rostos produzidos – depois de um tempo, todos eram praticamente iguais.

Imagine o exemplo da caneta esferográfica novamente. Aquela descrição dada lá em cima não compreende todas as canetas esferográficas existentes; nem todas são transparentes, algumas escrevem com mais de uma cor, nem todas têm tampa e por aí vai.

Se uma IA tem mais referências de uma caneta padrão ENEM, ela vai produzir mais resultados que se pareçam com ela – e eles serão, em geral, melhores. Selecionar os “melhores resultados” também é é selecionar os resultados mais abundantes na internet e nos bancos de dados, o que pode reforçar certos enviesamentos e preconceitos.

Outras tentativas dos pesquisadores de desviar do problema apenas retardaram a piora, que sempre chegava mais cedo ou mais tarde. Para eles, grandes empresas de tecnologia não serão tão afetadas, por poderem bancar filtragens dos dados que treinarão suas IAs. A bucha vai ficar para empresas menores, que extraem os dados integralmente da internet e podem, sem querer, incorporar imagens sintéticas.